Wie lernen Maschinen aus ihren Irrtümern und verbessern sich kontinuierlich? Die Anpassung der Gewichte spielt dabei eine zentrale Rolle, vor allem in der Welt der neuronalen Netzwerke. Diese Technik befähigt künstliche Intelligenzen (KI), Daten effektiv zu verarbeiten und sich neuen Informationen anzupassen.

Ähnlich dem menschlichen Gehirn, das durch neuronale Verbindungen lernt, verbessert sich ein neuronales Netz durch Gewichtsanpassung. Aber was verbirgt sich genau hinter diesem Prozess?

Die Parallelen zwischen dem Lernen des Menschen und der Adaptivität von KI sind verblüffend. Tauchen Sie tiefer ein, um die Geheimnisse hinter der Gewichtsanpassung zu enthüllen. Erfahren Sie, warum sie für den Erfolg im Bereich des maschinellen Lernens unerlässlich ist.

Einführung in neuronale Netzwerke und ihre Bedeutung

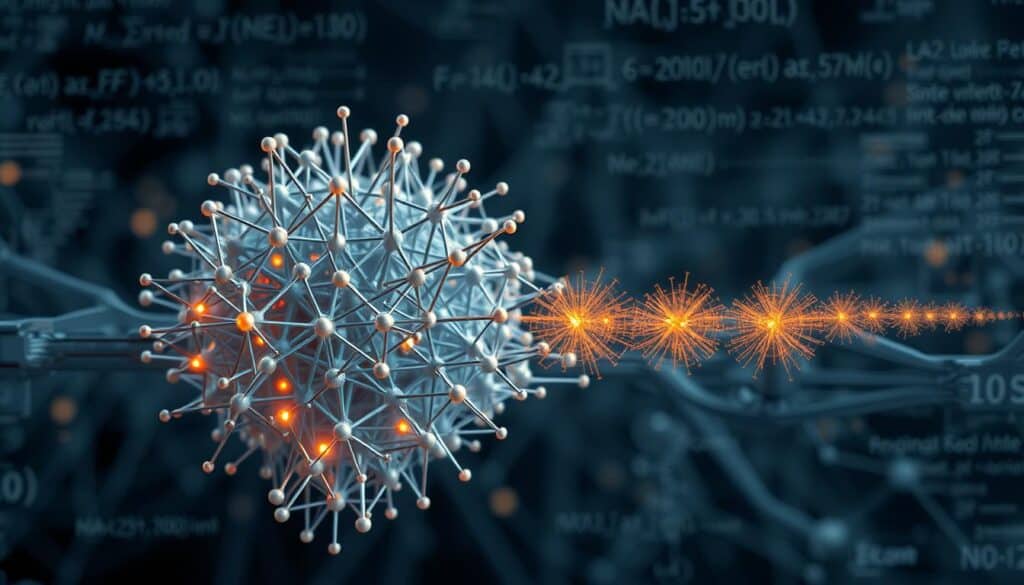

Neuronale Netzwerke bilden das Herzstück im Bereich KI-Grundlagen. Sie ahmen die Funktionsweise des menschlichen Gehirns nach, lernen aus Daten und erkennen Muster. Ein tiefer Einblick in neuronale Netzwerke erlaubt das Verständnis ihrer grundlegenden Konzepte und Aufbauten.

Im Kern setzen sich neuronale Netzwerke aus vielfältig vernetzten Elementen zusammen, den sogenannten „Neuronen“. Diese Elemente sind in Schichten angeordnet, die jeweils spezifische Datenelemente analysieren und verarbeiten. Diese Struktur ermöglicht es neuronalen Netzwerken, auch komplexeste Zusammenhänge in Datenmengen zu identifizieren.

Die revolutionäre Bedeutung neuronaler Netzwerke manifestiert sich in vielfältigen Hightech-Anwendungen. Sprach- und Bilderkennungstechnologien, wie sie in Amazons Alexa oder Smartphone-Gesichtserkennungssystemen zum Einsatz kommen, basieren auf neuronalen Netzwerken. Sie stellen damit den Grundstein für zahlreiche Innovationen im Bereich der künstlichen Intelligenz dar.

Zusammenfassend sind neuronale Netzwerke eine fundamental wichtige Technologie für die KI-Grundlagen. Sie spielen eine Schlüsselrolle bei der Entwicklung fortschrittlicher Anwendungen, die menschliches Können imitieren. Durch das Verständnis neuronaler Netzwerke können wir die transformative Kraft dieser Technologien auf unsere Welt realisieren.

Grundaussagen der Gewichtsanpassung

Die Anpassung von Gewichten ist entscheidend beim Training neuronaler Netzwerke. Diese Justierung ermöglicht es ihnen, auf optimalem Niveau zu funktionieren. Ein vertieftes Verständnis der Bedeutung Gewichtsanpassung erhöht die Effizienz dieser Netzwerke. Lassen Sie uns die wesentlichen Konzepte dahinter erkunden.

Was bedeutet Gewichtsanpassung?

Gewichtsanpassung bedeutet, die Gewichte in neuronalen Netzwerken fortwährend zu ändern. Dadurch steigern wir die Präzision von Vorhersagen. Mittels Techniken wie dem Gradientenabstieg zielen wir darauf ab, Fehler zu reduzieren. Die Bedeutung Gewichtsanpassung prägt, wie Netzwerke durch Erfahrung lernen und sich verbessern.

Die Wichtigkeit der Gewichtsoptimierung

Essenziell für die Effektivität künstlicher Intelligenz ist die Optimierung der Gewichte. Sie gewährleistet, dass Neuronen harmonisch funktionieren für beste Resultate. Gewichtsoptimierung fördert schnelle Konvergenz und reduziert Overfitting. Spezielle Strategien stärken das Netzwerk, machen es fitter und steigern die Performance. Gewichtsoptimierung ist somit Schlüssel für präzise Ergebnisse und verbesserte Systemleistung.

Wie neuronale Netzwerke durch Gewichtsanpassung lernen

Neuronale Netzwerke lernen durch die Anpassung ihrer Gewichte. Dieser Prozess nutzt Trainingsdaten, um Vorhersagen genauer zu machen. Ein sorgfältiges Gewichtsmanagement spielt eine Schlüsselrolle, um Effizienzsteigerung zu erreichen und die Leistung zu verbessern.

Rolle der Gewichtsoptimierung

Die Gewichtsoptimierung ist entscheidend für das Lernen neuronaler Netzwerke. Durch genaue Anpassungen lernen die Netzwerke, Muster in Daten zu erkennen. Das Ergebnis sind verbesserte Vorhersagen und eine geringere Fehlerquote.

Wie Gewichtsmanagement die Effizienz erhöht

Durch Gewichtsmanagement wird Effizienzsteigerung erreicht. Kontinuierliches Tuning der Gewichte beschleunigt das Lernen. So werden weniger Ressourcen verbraucht, was Zeit und Kosten spart. Ein effizient gemanagtes Netzwerk erreicht schnellere und genauere Ergebnisse, was in vielen Bereichen entscheidend ist.

Methoden der Gewichtsanpassung in neuronalen Netzwerken

Die Methoden zur Gewichtsanpassung in neuronalen Netzwerken verbessern Lernleistung und Effizienz. Techniken und Algorithmen wie Backpropagation und Gradient Descent sind dabei essentiell.

Gewichtsreduktion zur Fehlerminimierung

Zur Fehlerminimierung ist die Gewichtsreduktion bei Modellentwicklungen unerlässlich. Durch feine Gewichtsanpassungen verringert sich kontinuierlich der Fehler der Vorhersagen. So steigt die Genauigkeit und Zuverlässigkeit des Modells.

Gewichtsverlust durch reguliertes Lernen

Beim regulierten Lernen wird effektiv die Gewichtsanpassung gesteuert. Es verhindert, dass das Netzwerk sich zu stark anpasst, was Überanpassung vermeidet. Die Balance von Lernrate und Stabilität ist für generalisierte Lösungen kritisch.

Gewichtsanpassungsmethoden für schnelle Anpassung

Techniken wie die Stochastic Gradient Descent (SGD) fördern schnelles Lernen. Diese ermöglichen es neuronalen Netzwerken, sich flink auf neue Daten einzustellen. Für eine robuste und flexible Modellentwicklung ist die korrekte Umsetzung dieser Techniken entscheidend.

Vorteile der effektiven Gewichtsanpassung

Eine effektive Gewichtsanpassung in neuronalen Netzwerken steigert deren Leistung und Lernfähigkeit erheblich. Diese Aspekte sind für die Funktionsweise der Modelle essenziell.

Verbesserung der Leistung

Der Hauptvorteil der Gewichtsanpassung liegt in der Leistungssteigerung des Netzwerks. Durch feinjustierte Gewichte lässt sich die Präzision von Vorhersagen signifikant erhöhen. Dies verbessert nicht nur die sofortige Performance. Es steigert auch die langfristige Zuverlässigkeit und Effizienz der Modelle.

Erhöhung der Lernkapazität

Ein weiterer zentraler Nutzen ist die gesteigerte Lernkapazität. Modelle, die effektiv justiert sind, lernen schneller und präziser. Das beschleunigt das Training insgesamt. Dadurch können sich die Modelle schneller neuen Daten anpassen und flexibler wachsen.

Zusammenfassend ist die Gewichtsanpassung essentiell für die Verbesserung von Leistung und Lernfähigkeit neuronaler Netzwerke. Sie ist damit ein Schlüsselelement in der Welt der Datenwissenschaft und KI.

Häufige Herausforderungen bei der Gewichtsanpassung

Neuronale Netzwerke begegnen bei der Gewichtsanpassung mannigfaltigen Herausforderungen. Diese können gravierende Leistungsprobleme nach sich ziehen. Eine maßgebliche Schwierigkeit stellt das Auftreten lokaler Minima dar. Es ist von essenzieller Bedeutung, Methoden zu finden, um diese Hürden zu meistern.

Ein kritisches Problem in der Optimierung der Gewichte ist das Overfitting. Dies passiert, wenn sich das Netzwerk zu stark an Trainingsdaten anpasst. Dadurch verliert es an Anpassungsfähigkeit und die Fähigkeit zur Generalisierung sinkt. Techniken wie Dropout und die Nutzung regulärer Testdaten sind essenziell, um Overfitting entgegenzuwirken.

Unteranpassung ist ebenso eine signifikante Herausforderung. Netzwerke, die nicht ausreichend angepasst sind, tun sich schwer darin, Muster in Daten zu erkennen. Dies resultiert in unzureichenden Vorhersagen. Die Anpassung der Lernrate sowie die Ausdehnung der Trainingsepochen können Abhilfe schaffen.

Zusammengefasst können die besprochenen Schwierigkeiten durch spezifische Maßnahmen überwunden werden. Eine kontinuierliche Überwachung der Schritte im Netzwerk ist hierbei unerlässlich. Versteht und meistert man diese Herausforderungen, kann dies die Leistungsfähigkeit eines neuronalen Netzwerks deutlich erhöhen.

Tipps und Strategien für eine erfolgreiche Gewichtsanpassung

Effektive Gewichtsanpassung ist für das Training neuronaler Netzwerke entscheidend. Wir teilen bewährte Tipps und Strategien, die die Leistung Ihres Modells verbessern.

Gewichtsanpassungstipps für Anfänger

Neulinge sollten mit den Grundlagen der Gewichtsanpassung beginnen. Hier sind einige einführende Hinweise:

- Verständnis der Grundprinzipien der Gewichtsregulierung

- Verwendung einfacher Anpassungsprogramme

- Durchführung häufiger Bewertungen der Gewichtsverteilung

Gewichtsregulierungstechniken

Gewichtsregulierung ist für die Leistung neuronaler Netzwerke essenziell. Folgende Techniken sind spezifisch dafür geeignet:

- Implementierung von Regularisierungsmaßnahmen

- Anwendung von Optimierungsalgorithmen wie Adam oder RMSprop

- Überwachung der Gewichtsregulierung während des Trainings

Gewichtsanpassungsprogramm für Fortgeschrittene

Für erfahrene Anwender sind spezielle Anpassungsprogramme und Tools empfehlenswert. Sie steigern die Effizienz deutlich:

- Nutzung von Frameworks wie TensorFlow und PyTorch

- Experimentieren mit komplexen Modellen und Architekturen

- Einsatz von Hyperparameter-Optimierungstools

Diese Tipps Gewichtsanpassung helfen Anfängern und Fortgeschrittenen, effektiver zu arbeiten. Eine sorgfältige Gewichtsregulierung und das richtige Anpassungsprogramm sind entscheidend für den Erfolg.

Praktische Anwendung der Gewichtsanpassungsmethoden

Die praktische Anwendung der Gewichtsanpassungsmethoden ist in vielen Bereichen wesentlich. Im Finanzsektor helfen sie, Algorithmen zu verfeinern, die Markttrends vorhersagen. Sie erkennen auch Betrugsmuster. Dadurch können Banken und Versicherungen bessere Entscheidungen fällen.

In der Medizin sind diese Methoden extrem wertvoll. Sie ermöglichen es neuronalen Netzwerken, genaue Diagnosen zu stellen. Auch personalisierte Behandlungsempfehlungen werden dadurch möglich. Dies steigert die Erfolgsaussichten bei Patienten und optimiert den Ressourceneinsatz.

Beim autonomen Fahren sind Gewichtsanpassungsmethoden zentral. Sie trainieren Fahrzeugsysteme, um in Echtzeit korrekte Entscheidungen zu treffen, was die Sicherheit verbessert. Unterstützt durch realistische Trainingsdaten und Testumgebungen, passen sich die Algorithmen an diverse Fahrszenarien an.

Die hohe Relevanz der praktische Anwendung der Gewichtsanpassungsmethoden in unserer Technologie geht daraus hervor. Sie treibt die Entwicklung und Verfeinerung von Lösungen voran, die im realen Leben sehr wertvoll sind.

Fazit

Die Gewichtsanpassung spielt eine Schlüsselrolle beim Lernen in neuronalen Netzwerken. Wir haben unterschiedliche Facetten beleuchtet und die Wichtigkeit effektiver Optimierung betont. Die Zusammenfassung Gewichtsanpassung unterstreicht, wie essenziell tiefes Verständnis und präzise Methodenanwendung für die Verbesserung von KI-Systemen sind.

Die grundlegenden Konzepte und ihre Bedeutung für die Fehlerreduktion und Effizienzsteigerung wurden zuerst diskutiert. Dann haben wir Methoden, Herausforderungen und Implementierungstipps besprochen. Die neuronale Netzwerke Anwendung profitiert stark von einer durchdachten Gewichtsanpassung.

Indem wir diese Methoden praktisch anwenden, sehen wir, wie neuronale Netzwerke effizient lernen. Die zukünftige Weiterentwicklung wird die Potenz von Maschinenlernen und KI enorm steigern. Es ist faszinierend, den technologischen und datenverarbeitenden Fortschritt zu beobachten, der aus diesen Entwicklungen resultiert.

FAQ

Q: Was bedeutet Gewichtsanpassung?

Q: Warum ist die Gewichtsoptimierung so wichtig?

Q: Wie funktioniert die Gewichtsregulierung?

Q: Was ist Gewichtsmanagement?

Q: Welche Rolle spielt die Gewichtsreduktion?

Q: Was sind die häufigsten Herausforderungen bei der Gewichtsanpassung?

Q: Welche Techniken helfen bei der Gewichtsanpassung?

Q: Gibt es bestimmte Softwarelösungen zur Unterstützung der Gewichtsanpassung?

Q: Wie kann die Gewichtsoptimierung die Leistung eines Modells steigern?

Q: Was sind Gewichtsanpassungstipps für Anfänger?

Q: Wie sieht ein gewichtsanpassungsprogramm für Fortgeschrittene aus?

Wie lernen Maschinen aus ihren Irrtümern und verbessern sich kontinuierlich? Die Anpassung der Gewichte spielt dabei eine zentrale Rolle, vor allem in der Welt der neuronalen Netzwerke. Diese Technik befähigt künstliche Intelligenzen (KI), Daten effektiv zu verarbeiten und sich neuen Informationen anzupassen.

Ähnlich dem menschlichen Gehirn, das durch neuronale Verbindungen lernt, verbessert sich ein neuronales Netz durch Gewichtsanpassung. Aber was verbirgt sich genau hinter diesem Prozess?

Die Parallelen zwischen dem Lernen des Menschen und der Adaptivität von KI sind verblüffend. Tauchen Sie tiefer ein, um die Geheimnisse hinter der Gewichtsanpassung zu enthüllen. Erfahren Sie, warum sie für den Erfolg im Bereich des maschinellen Lernens unerlässlich ist.

Einführung in neuronale Netzwerke und ihre Bedeutung

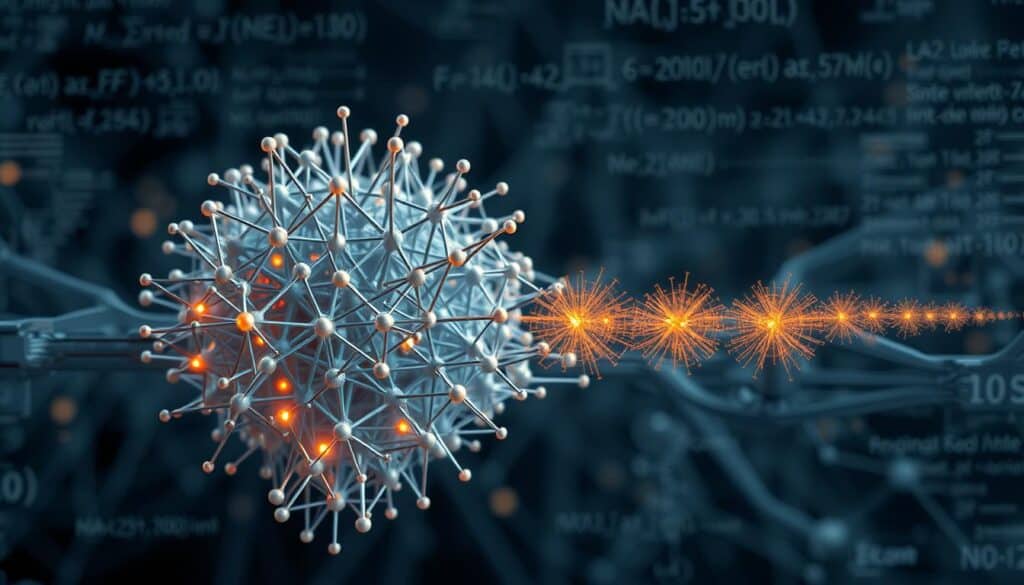

Neuronale Netzwerke bilden das Herzstück im Bereich KI-Grundlagen. Sie ahmen die Funktionsweise des menschlichen Gehirns nach, lernen aus Daten und erkennen Muster. Ein tiefer Einblick in neuronale Netzwerke erlaubt das Verständnis ihrer grundlegenden Konzepte und Aufbauten.

Im Kern setzen sich neuronale Netzwerke aus vielfältig vernetzten Elementen zusammen, den sogenannten „Neuronen“. Diese Elemente sind in Schichten angeordnet, die jeweils spezifische Datenelemente analysieren und verarbeiten. Diese Struktur ermöglicht es neuronalen Netzwerken, auch komplexeste Zusammenhänge in Datenmengen zu identifizieren.

Die revolutionäre Bedeutung neuronaler Netzwerke manifestiert sich in vielfältigen Hightech-Anwendungen. Sprach- und Bilderkennungstechnologien, wie sie in Amazons Alexa oder Smartphone-Gesichtserkennungssystemen zum Einsatz kommen, basieren auf neuronalen Netzwerken. Sie stellen damit den Grundstein für zahlreiche Innovationen im Bereich der künstlichen Intelligenz dar.

Zusammenfassend sind neuronale Netzwerke eine fundamental wichtige Technologie für die KI-Grundlagen. Sie spielen eine Schlüsselrolle bei der Entwicklung fortschrittlicher Anwendungen, die menschliches Können imitieren. Durch das Verständnis neuronaler Netzwerke können wir die transformative Kraft dieser Technologien auf unsere Welt realisieren.

Grundaussagen der Gewichtsanpassung

Die Anpassung von Gewichten ist entscheidend beim Training neuronaler Netzwerke. Diese Justierung ermöglicht es ihnen, auf optimalem Niveau zu funktionieren. Ein vertieftes Verständnis der Bedeutung Gewichtsanpassung erhöht die Effizienz dieser Netzwerke. Lassen Sie uns die wesentlichen Konzepte dahinter erkunden.

Was bedeutet Gewichtsanpassung?

Gewichtsanpassung bedeutet, die Gewichte in neuronalen Netzwerken fortwährend zu ändern. Dadurch steigern wir die Präzision von Vorhersagen. Mittels Techniken wie dem Gradientenabstieg zielen wir darauf ab, Fehler zu reduzieren. Die Bedeutung Gewichtsanpassung prägt, wie Netzwerke durch Erfahrung lernen und sich verbessern.

Die Wichtigkeit der Gewichtsoptimierung

Essenziell für die Effektivität künstlicher Intelligenz ist die Optimierung der Gewichte. Sie gewährleistet, dass Neuronen harmonisch funktionieren für beste Resultate. Gewichtsoptimierung fördert schnelle Konvergenz und reduziert Overfitting. Spezielle Strategien stärken das Netzwerk, machen es fitter und steigern die Performance. Gewichtsoptimierung ist somit Schlüssel für präzise Ergebnisse und verbesserte Systemleistung.

Wie neuronale Netzwerke durch Gewichtsanpassung lernen

Neuronale Netzwerke lernen durch die Anpassung ihrer Gewichte. Dieser Prozess nutzt Trainingsdaten, um Vorhersagen genauer zu machen. Ein sorgfältiges Gewichtsmanagement spielt eine Schlüsselrolle, um Effizienzsteigerung zu erreichen und die Leistung zu verbessern.

Rolle der Gewichtsoptimierung

Die Gewichtsoptimierung ist entscheidend für das Lernen neuronaler Netzwerke. Durch genaue Anpassungen lernen die Netzwerke, Muster in Daten zu erkennen. Das Ergebnis sind verbesserte Vorhersagen und eine geringere Fehlerquote.

Wie Gewichtsmanagement die Effizienz erhöht

Durch Gewichtsmanagement wird Effizienzsteigerung erreicht. Kontinuierliches Tuning der Gewichte beschleunigt das Lernen. So werden weniger Ressourcen verbraucht, was Zeit und Kosten spart. Ein effizient gemanagtes Netzwerk erreicht schnellere und genauere Ergebnisse, was in vielen Bereichen entscheidend ist.

Methoden der Gewichtsanpassung in neuronalen Netzwerken

Die Methoden zur Gewichtsanpassung in neuronalen Netzwerken verbessern Lernleistung und Effizienz. Techniken und Algorithmen wie Backpropagation und Gradient Descent sind dabei essentiell.

Gewichtsreduktion zur Fehlerminimierung

Zur Fehlerminimierung ist die Gewichtsreduktion bei Modellentwicklungen unerlässlich. Durch feine Gewichtsanpassungen verringert sich kontinuierlich der Fehler der Vorhersagen. So steigt die Genauigkeit und Zuverlässigkeit des Modells.

Gewichtsverlust durch reguliertes Lernen

Beim regulierten Lernen wird effektiv die Gewichtsanpassung gesteuert. Es verhindert, dass das Netzwerk sich zu stark anpasst, was Überanpassung vermeidet. Die Balance von Lernrate und Stabilität ist für generalisierte Lösungen kritisch.

Gewichtsanpassungsmethoden für schnelle Anpassung

Techniken wie die Stochastic Gradient Descent (SGD) fördern schnelles Lernen. Diese ermöglichen es neuronalen Netzwerken, sich flink auf neue Daten einzustellen. Für eine robuste und flexible Modellentwicklung ist die korrekte Umsetzung dieser Techniken entscheidend.

Vorteile der effektiven Gewichtsanpassung

Eine effektive Gewichtsanpassung in neuronalen Netzwerken steigert deren Leistung und Lernfähigkeit erheblich. Diese Aspekte sind für die Funktionsweise der Modelle essenziell.

Verbesserung der Leistung

Der Hauptvorteil der Gewichtsanpassung liegt in der Leistungssteigerung des Netzwerks. Durch feinjustierte Gewichte lässt sich die Präzision von Vorhersagen signifikant erhöhen. Dies verbessert nicht nur die sofortige Performance. Es steigert auch die langfristige Zuverlässigkeit und Effizienz der Modelle.

Erhöhung der Lernkapazität

Ein weiterer zentraler Nutzen ist die gesteigerte Lernkapazität. Modelle, die effektiv justiert sind, lernen schneller und präziser. Das beschleunigt das Training insgesamt. Dadurch können sich die Modelle schneller neuen Daten anpassen und flexibler wachsen.

Zusammenfassend ist die Gewichtsanpassung essentiell für die Verbesserung von Leistung und Lernfähigkeit neuronaler Netzwerke. Sie ist damit ein Schlüsselelement in der Welt der Datenwissenschaft und KI.

Häufige Herausforderungen bei der Gewichtsanpassung

Neuronale Netzwerke begegnen bei der Gewichtsanpassung mannigfaltigen Herausforderungen. Diese können gravierende Leistungsprobleme nach sich ziehen. Eine maßgebliche Schwierigkeit stellt das Auftreten lokaler Minima dar. Es ist von essenzieller Bedeutung, Methoden zu finden, um diese Hürden zu meistern.

Ein kritisches Problem in der Optimierung der Gewichte ist das Overfitting. Dies passiert, wenn sich das Netzwerk zu stark an Trainingsdaten anpasst. Dadurch verliert es an Anpassungsfähigkeit und die Fähigkeit zur Generalisierung sinkt. Techniken wie Dropout und die Nutzung regulärer Testdaten sind essenziell, um Overfitting entgegenzuwirken.

Unteranpassung ist ebenso eine signifikante Herausforderung. Netzwerke, die nicht ausreichend angepasst sind, tun sich schwer darin, Muster in Daten zu erkennen. Dies resultiert in unzureichenden Vorhersagen. Die Anpassung der Lernrate sowie die Ausdehnung der Trainingsepochen können Abhilfe schaffen.

Zusammengefasst können die besprochenen Schwierigkeiten durch spezifische Maßnahmen überwunden werden. Eine kontinuierliche Überwachung der Schritte im Netzwerk ist hierbei unerlässlich. Versteht und meistert man diese Herausforderungen, kann dies die Leistungsfähigkeit eines neuronalen Netzwerks deutlich erhöhen.

Tipps und Strategien für eine erfolgreiche Gewichtsanpassung

Effektive Gewichtsanpassung ist für das Training neuronaler Netzwerke entscheidend. Wir teilen bewährte Tipps und Strategien, die die Leistung Ihres Modells verbessern.

Gewichtsanpassungstipps für Anfänger

Neulinge sollten mit den Grundlagen der Gewichtsanpassung beginnen. Hier sind einige einführende Hinweise:

- Verständnis der Grundprinzipien der Gewichtsregulierung

- Verwendung einfacher Anpassungsprogramme

- Durchführung häufiger Bewertungen der Gewichtsverteilung

Gewichtsregulierungstechniken

Gewichtsregulierung ist für die Leistung neuronaler Netzwerke essenziell. Folgende Techniken sind spezifisch dafür geeignet:

- Implementierung von Regularisierungsmaßnahmen

- Anwendung von Optimierungsalgorithmen wie Adam oder RMSprop

- Überwachung der Gewichtsregulierung während des Trainings

Gewichtsanpassungsprogramm für Fortgeschrittene

Für erfahrene Anwender sind spezielle Anpassungsprogramme und Tools empfehlenswert. Sie steigern die Effizienz deutlich:

- Nutzung von Frameworks wie TensorFlow und PyTorch

- Experimentieren mit komplexen Modellen und Architekturen

- Einsatz von Hyperparameter-Optimierungstools

Diese Tipps Gewichtsanpassung helfen Anfängern und Fortgeschrittenen, effektiver zu arbeiten. Eine sorgfältige Gewichtsregulierung und das richtige Anpassungsprogramm sind entscheidend für den Erfolg.

Praktische Anwendung der Gewichtsanpassungsmethoden

Die praktische Anwendung der Gewichtsanpassungsmethoden ist in vielen Bereichen wesentlich. Im Finanzsektor helfen sie, Algorithmen zu verfeinern, die Markttrends vorhersagen. Sie erkennen auch Betrugsmuster. Dadurch können Banken und Versicherungen bessere Entscheidungen fällen.

In der Medizin sind diese Methoden extrem wertvoll. Sie ermöglichen es neuronalen Netzwerken, genaue Diagnosen zu stellen. Auch personalisierte Behandlungsempfehlungen werden dadurch möglich. Dies steigert die Erfolgsaussichten bei Patienten und optimiert den Ressourceneinsatz.

Beim autonomen Fahren sind Gewichtsanpassungsmethoden zentral. Sie trainieren Fahrzeugsysteme, um in Echtzeit korrekte Entscheidungen zu treffen, was die Sicherheit verbessert. Unterstützt durch realistische Trainingsdaten und Testumgebungen, passen sich die Algorithmen an diverse Fahrszenarien an.

Die hohe Relevanz der praktische Anwendung der Gewichtsanpassungsmethoden in unserer Technologie geht daraus hervor. Sie treibt die Entwicklung und Verfeinerung von Lösungen voran, die im realen Leben sehr wertvoll sind.

Fazit

Die Gewichtsanpassung spielt eine Schlüsselrolle beim Lernen in neuronalen Netzwerken. Wir haben unterschiedliche Facetten beleuchtet und die Wichtigkeit effektiver Optimierung betont. Die Zusammenfassung Gewichtsanpassung unterstreicht, wie essenziell tiefes Verständnis und präzise Methodenanwendung für die Verbesserung von KI-Systemen sind.

Die grundlegenden Konzepte und ihre Bedeutung für die Fehlerreduktion und Effizienzsteigerung wurden zuerst diskutiert. Dann haben wir Methoden, Herausforderungen und Implementierungstipps besprochen. Die neuronale Netzwerke Anwendung profitiert stark von einer durchdachten Gewichtsanpassung.

Indem wir diese Methoden praktisch anwenden, sehen wir, wie neuronale Netzwerke effizient lernen. Die zukünftige Weiterentwicklung wird die Potenz von Maschinenlernen und KI enorm steigern. Es ist faszinierend, den technologischen und datenverarbeitenden Fortschritt zu beobachten, der aus diesen Entwicklungen resultiert.